Нейросетевые музыкальные видео как новая форма медиа-арта (2022–2025)

КОНЦЕПЦИЯ

Современная музыкальная культура всё активнее использует нейросети для создания визуального контента. За последние три года музыкальные клипы и сниппеты, полностью или частично сгенерированные искусственным интеллектом, стали новой нормой визуального выражения. Проблема заключается в том, что граница между технологией и искусством размывается: кто является автором — человек или алгоритм? Это исследование актуально потому, что нейросетевые музыкальные видео становятся не просто иллюстрацией к песне, а самостоятельной формой медиа-арта, в которой рождается новый визуальный язык и способ восприятия музыки в цифровую эпоху.

Главная гипотеза исследования — это то, что нейросетевые музыкальные видео сейчас — не просто побочный эффект цифровых технологий, а новая художественная форма. Алгоритм в них становится полноценным участником творческого процесса, а музыкальное видео превращается в гибрид искусства, программирования и коммуникации внутри сети между артистом и его аудиторией.

В данном исследовании рассматривается, как нейросети изменили эстетику музыкальных видео и восприятие музыкальной индустрии в целом. В основе концепции — идея, что современный визуальный язык формируется не сколько человеком, столько взаимодействием человека и алгоритма.

AI-клипы создаются на стыке автоматической генерации и авторского решения: художник задаёт направление, но финальная визуальная форма рождается внутри сети. Таким образом, нейросетевые музыкальные видео можно рассматривать как новый тип сетевого медиа-арта, где главная художественная ценность — не сюжет, а процесс генерации и форма восприятия. Это искусство потока и алгоритма, которое живёт в ритме социальных платформ, музыкальных стримингов и визуальных трендов.

С 2022 года нейросети (Runway, Midjourney, Kaiber, Pika, CreateAI, Suno) стали доступны каждому, а музыкальные клипы превратились в площадку для художественных экспериментов с искусственным интеллектом. Эти видео задают новые вопросы о визуальной культуре, авторстве и роли алгоритмов в искусстве. В связи с чем появляются как неограниченные возможности для визуализации треков и привлечения аудитории (интересные решения, смешные завлекающие сюжеты), так и вопрос, стоит ли считать сгенерированные клипы самостоятельным произведением искусства.

Логотипы ключевых нейросестевых моделей для создания видеороликов

Рубрикатор:

1. Введение и концепция

2. Появление нейросетевых видео в музыкальной индустрии (2022–2025) — развитие инструментов (Kaiber, Runway, Midjourney, Pika, Stable Diffusion) — первые кейсы крупных артистов и независимых авторов. 3. Нейросеть как новый медиахудожник

4. Эстетика и визуальные паттерны нейросетевых музыкальных клипов 4.1. Абстракции и генеративная среда 4.2. Цифровая эстетика и глитч 4.3. Идентичность, лицо и трансформация

5. Заключение

Принцип отбора иллюстративного материала основан на том, чтобы в каждом разделе показать самые характерные визуальные приёмы нейросетевых музыкальных видео. Для иллюстраций выбираются кадры, где лучше всего видны основные паттерны из рубрикатора: генеративные абстракции, цифровой глитч, трансформация лица и другие. Для каждого кейса подбирается несколько кадров, которые отражают его собственную визуальную логику и помогают сравнить разные типы AI-эстетики.

Появление и развитие нейросетевых видео в музыкальной индустрии

Первые примеры использования нейросетей в музыкальной индустрии как профессионального инструмента появились еще в 2019 году. Только начиная развиваться, они уже проявили себя как ресурс, которые способны генерировать реальные художественные образы.

Так, например, важным в этом отношении будет упомянуть ролик «Егор Летов — Убегает весь мир. Видеотрибьют от Яндекс.Музыки». Нейросеть в данном случае уже работает не как иллюстратор, а как «исследователь» текстов Летова. Она выявляет повторяющиеся образы, сортирует их по частотности и фактически реконструирует его авторскую мифологию. По сути, алгоритм собирает «словесную вселенную» Летова и превращает её в визуальный словарь.

Фрагмент клипа «Егор Летов — Убегает весь мир. Видеотрибьют от Яндекс.Музыки» (2019) (источник: https://youtu.be/_TTwA5dYsgE?si=HXfsTW0hp-EQEnm3)

Визуальная среда кажется текучей, живой, иногда нелогичной — это и есть признак генеративности. Образы взаимодействуют по собственной внутренней логике: кролики бегут сквозь лес, трактор пересекает пространство, качели движутся без опоры в реальности. Картина складывается как поток, а не как выстроенный сюжет.

Фрагмент клипа «Егор Летов — Убегает весь мир. Видеотрибьют от Яндекс.Музыки» (2019) (источник: https://youtu.be/_TTwA5dYsgE?si=HXfsTW0hp-EQEnm3)

Уже в 2019 году нейросеточное видео — это не иллюстрация песни, а итоговая визуальная карта мифологического мира Летова, созданная на основе алгоритмического анализа1.

То есть нейросеть выступила как: - исследователь текста, - собиратель образов, - визуализатор, - интерпретатор, - соавтор.

1Пауэр, К. Ю. Нейросети как инструмент генерации художественных образов на примере клипа «Убегает весь мир» на песню Егора Летова «Без меня» / К. Ю. Пауэр, А. А. Кузнецов // Языкознание и литературоведение. — 2023. — С. 164.

Фрагмент клипа «Егор Летов — Убегает весь мир. Видеотрибьют от Яндекс.Музыки» (2019) (источник: https://youtu.be/_TTwA5dYsgE?si=HXfsTW0hp-EQEnm3)

Первые музыкальные видео с использованием нейросетей и выглядели, мягко говоря, экспериментально. Это были ролики со случайными визуальными эффектами, неустойчивыми переходами и «плывущими» текстурами, как в ранних DIY-видео обычных пользователей или TikTok-авторов. Однако именно такие работы задали направление: артисты и независимые исполнители почувствовали, что генеративная картинка может стать новым визуальным языком, а не просто эффектом, и при правильном использовании способна воплощать самые разные идеи.

Однако период с 2022 по 2025 год стал моментом, когда нейросети перестали быть экспериментом отдельных пользователей и вошли в музыкальную индустрию как полноценный визуальный инструмент. Прорыв Runway, Midjourney, Kaiber, Stable Diffusion и других ИИ платформ дал артистам возможность создавать клипы без съёмок, студий и команд — буквально «рисовать» видео музыкой. Первые крупные релизы быстро показали, что AI-визуал может стать не просто стилистикой, а новым форматом музыкального медиа-арта.

Так появились более технически проработанные и выразительные ролики, в которых ИИ становится полноценным инструментом художественной визуализации. Даже группы, далекие от массовых трендов, начали экспериментировать с генеративной анимацией. Например, Within Temptation в клипе «Bleed Out» использует ИИ для создания визуальных эффектов, которые подчеркивают драматизм и глубину музыкальной композиции. Это показывает, что AI-визуализация выходит далеко за пределы электропопа или хип-хопа, становясь инструментом для создания сложных и эмоционально насыщенных видео вне зависимости от жанра.

Кадры из клипа «Within Temptation — Bleed Out» (2023) (источник: https://youtu.be/dBilK-h3lRQ?si=eyU_NPcRZ2qxnk8N)

В 2024 году вышел клип Washed Out — «The Hardest Part». В нем демонстрируется, как алгоритмы могут создавать уникальный визуальный мир, усиливая эмоциональное воздействие музыки. Здесь ИИ используется для построения плавных, гипнотических образов, которые органично вписываются в атмосферу «dream pop», делая видео одновременно мягким и визуально насыщенным. Мир внутри ролика — почти реальный, нейросеть выдают только нереалистичные браки в картинке, которые свойственны генеративным программам.

Эпизод из клипа «Washed Out — The Hardest Part» (2024) (источник: https://youtu.be/-Nb-M1GAOX8?si=0hEHA_IMmKw-KBKS)

Кадры из клипа «Washed Out — The Hardest Part» (2024) (источник: https://youtu.be/-Nb-M1GAOX8?si=0hEHA_IMmKw-KBKS)

К 2025 году появились более цельные проекты. Например, инди-группы начали выпускать собственные AI-клипы без больших бюджетов — как это сделал коллектив Limebridge с видео Limebridge — «Reason» (Official Music Video), полностью построенным на генерации через Sora, но уже обладающим цельным сюжетом.

Кадры из клипа «Limebridge — Reason» (2025) (источник: https://youtu.be/qvhHhV1Atyk?si=wMzaT_Bri7L9bbGP)

«Для нашей новой песни мы использовали ИИ (Sora), чтобы создать весь музыкальный видеоклип. Я написал сценарий и сам смонтировал все, но все визуальные эффекты были сгенерированы ИИ. Честно говоря, нам очень нравится, как это получилось. Это немного эмоционально, странно, драматично… Но теперь мы застряли с вопросом: считается ли это искусством, если в его создании помогла машина? Убирает ли использование ИИ часть смысла? Или, может быть, это просто старомодное мышление?»2 - 2Солист группы о клипе «Reason» на сайте Reddit

Кадры из клипа «Limebridge — Reason» (2025) (источник: https://youtu.be/qvhHhV1Atyk?si=wMzaT_Bri7L9bbGP)

В результате, нейросетевые технологии не только становятся инструментом для экспериментов, но и формируют новую эстетику музыкальных видео, объединяя музыку, визуальные эффекты и алгоритмическое творчество в единое художественное пространство.

Но все чаще звучит вопрос, может ли видео, созданное нейросетью, встать вровень с режиссерской работой и клипами, снятыми огромными командами, или оно так и останется на границе между искусством и «второсортным» творчеством.

Нейросеть как новый медиахудожник в музыкальных видео

В последние годы нейросети перестали быть просто инструментом обработки изображения и фактически превратились в нового медиахудожника, способного формировать собственный визуальный язык внутри музыкальных видео. Алгоритм больше не выполняет вспомогательную техническую функцию — он сам создаёт образы, структурирует пространство клипа, устанавливает логику движения и даже предлагает неожиданные решения, которые не возникли бы в работе человеческого автора.

Благодаря этому музыкальные видео становятся гибридными произведениями, в которых визуальная среда рождается на пересечении человеческого замысла и машинного воображения. Именно это превращает нейросетевой клип из технического эксперимента в полноценное медиахудожественное высказывание.

Фрагмент перехода в клипе «Lost [Official Music Video] — Linkin Park» (2023) (источник: https://youtu.be/7NK_JOkuSVY?si=HcU4i8Go6CJWGizI)

Клип Linkin Park — «Lost» — хороший пример художественного высказывания нейросети. В нём Kaiber не просто обработал архивные кадры в стиле японской манги, но и сам предложил визуальный стиль, в котором изображение превращается в полноценную анимированную среду. Многие переходы, изменения пластики лица, движения фона и цветовые всплески появились как результат генерации, а не ручной анимации. Команда не прорисовывала кадры — нейросеть создавала их, соединяя фрагменты прошлого с новым визуальным языком. В итоге клип выглядит как самостоятельное художественное высказывание алгоритма: человеческая память о группе и машинная трактовка этой памяти.

Кадры из клипа «Lost [Official Music Video] — Linkin Park» (2023) (источник: https://youtu.be/7NK_JOkuSVY?si=HcU4i8Go6CJWGizI)

Еще один пример — клип James Adrian Brown — «Cadence». Его визуал полностью создан нейросетью, которая «слушает» музыку и сама решает, какие образы должны появляться. GAN превращает частоты, ритм и структуру композиции в движущиеся формы — это не монтаж и не ручная анимация, а именно генеративное искусство, где результат рождается из работы алгоритма.

Фрагмент из клипа «James Adrian Brown — Cadence» (2022) (источник: https://youtu.be/7OG2c03Gn1Y?si=ZV_RW1SLVygm9Sjw)

Кадры из клипа «James Adrian Brown — Cadence» (2022) (источник: https://youtu.be/7OG2c03Gn1Y?si=ZV_RW1SLVygm9Sjw)

В итоге «Cadence» можно отнести к медиа-арту потому, что всё визуальное содержание здесь рождается не из ручной анимации, а из работы нейросети, которая интерпретирует музыку как набор данных. Алгоритм не просто строит абстракции, а реагирует на звуковые параметры: с изменением темпа и частоты музыкальной дорожки меняются форма, насыщенность и динамика изображения. Цветовые решения тоже формируются автоматически — нейросеть «подбирает» цвет в соответствии с эмоциональным тоном фрагмента, делая одни части видео спокойными и мягкими, а другие — резкими, яркими и контрастными.

Разбор клипов James Adrian Brown — «Cadence» и Linkin Park — «Lost» показывает, что нейросеть в музыкальных видео уже работает не как просто «инструмент», а как полноценный автор визуальной стилистики. В «Cadence» алгоритм буквально реагирует на музыку: подстраивает цвет, меняет форму и темп изображений в зависимости от настроения трека. В «Lost» нейросеть не просто обрабатывает архивные кадры группы, а превращает их в новый визуальный мир, которого раньше не существовало.

И именно в этом проявляется новая роль нейросетей — они начинают создавать визуальный язык сами, вместе с человеком, а не по его указке генерировать четко то, что написано в промте. Они обучаются и позволяют создавать то, что не получится реализовать вживую только силами человека.

Эстетика и визуальные паттерны нейросетевых музыкальных клипов

ИИ-клипы часто выглядят как визуальные «следы» вычислений — появляется не просто изображение в привычном смысле, а результат того, как сеть интерпретирует звук, ритм, лицо или движение. Из-за этого в AI-видео появляются специфические паттерны: плавные переходы между несвязанных форм, нелогичные трансформации объектов, чрезмерные детали, цифровой шум или наоборот — стерильная чёткость, напоминающая рендер: «Нейросети, как правило, обучаются на больших объемах существующего контента. Это приводит к тому, что создаваемые ими работы могут быть восприняты как подражание или компиляция уже имеющихся стилей и сюжетов»3

- 3 Зайцев А. Я. Нейросети в современном анимационном искусстве: эстетические инновации и новые горизонты // Культура и искусство. — 2024. — № 12. — С. 73.

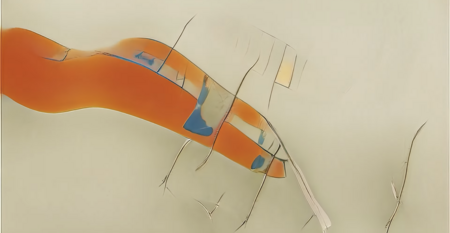

Абстракции и генеративная среда

Одно из самых характерных явлений в нейросетевых клипах — их стремление к абстракции. Алгоритм не обязан воспроизводить реальный мир, поэтому в кадре часто появляется текучая, нестабильная среда: формы растворяются, собираются заново, меняют цвет и масштаб. Такая визуальность ближе к генеративному искусству и напоминает цифровые живописные потоки, которые существуют по своим собственным правилам.

Вариации форм одного и того же изображения в клипе «Periphery — Atropos» (2023) (источник: https://youtu.be/Ppg8kpG-lio?si=1UwBcKsAmlil5Axm)

В клипе Periphery — «Atropos» особенно интересны абстрактные фоны и то, как в них вписывается смысловой элемент (например, машина). Фоны не просто заполняют пространство — они активно взаимодействуют с персонажами/предметами, меняясь и трансформируясь под воздействием алгоритма, что создаёт ощущение «живого мира» внутри клипа. То есть фоновые абстрактные ландшафты — это не просто фон, а активный участник визуального процесса, создающий ощущение, что мир — это «алгоритм».

Кадры из клипа «Periphery — Atropos» (2023) (источник: https://youtu.be/Ppg8kpG-lio?si=1UwBcKsAmlil5Axm)

В ряде сцен лица, руки или тела персонажей искажаются, плавятся, трансформируются под воздействием нейросетевой обработки. Это также является очень показательным паттерном, который появляется во многих нейросетевых клипах и становится их отличительной особенностью.

Кадры из клипа «Periphery — Atropos» (2023) (источник: https://youtu.be/Ppg8kpG-lio?si=1UwBcKsAmlil5Axm)

Генеративные фоны могут быть не только максимально расплывчатыми и абстрактными, как в примере выше, но и вполне конкретно отражать то, что поется в песне. Это могут быть детальные картины, в которых нет главного элемента, но зато сама обстановка в кадре доподлинно объясняет замысел музыкальной композиции. Например в клипе Disturbed — «Bad Man» фоны иллюстрируют смысловое содержание трека.

Кадры из клипа «Disturbed — Bad Man» (2022) (источник: https://youtu.be/fpUpVznI4Yc?si=YYuB04JbtzGfEXft)

Таким образом, генеративные фоны могут быть как абстракциями, дополняющими центральный элемент, так и самостоятельными художественными произведениями.

Цифровая эстетика и глитч

Цифровая эстетика в нейросетевых музыкальных клипах проявляется через использование визуальных «ошибок», искажений и нестабильной графики, известных как глитч. Эти элементы, изначально возникавшие как дефекты техники или сбои цифровых систем, сегодня стали самостоятельным художественным приёмом, который отличает сгенерированные ролики. Глитч и другие цифровые артефакты позволяют создавать ощущение нестабильной, текучей реальности, подчёркивая алгоритмическую природу визуала.

Кадры из клипа «Pnau, Bebe Rexha & Ozuna — Stars» (2023) (источник: https://youtu.be/Aox5s2s_SEI?si=mOt9vPFKxR79cejJ)

В клипе Pnau, Bebe Rexha & Ozuna — «Stars» глитч работает как часть общей логики нейросетевой трансформации. Вместо привычных спецэффектов в клип используются именно цифровые сбои — моменты, когда нейросеть «не успевает» перестроить образ и выдаёт характерные разрывы и дрожащие переходы.

Части кадра «зависают», размазываются, дублируются и превращаются в визуальные артефакты. Нейросеть рендерит космическую тему как поток цифрового шума: объекты плавают, искажаются, местами превращаются в абстрактные блики.

Кадры из клипа «Disturbed — Bad Man» (2022) (источник: https://youtu.be/fpUpVznI4Yc?si=YYuB04JbtzGfEXft)

Фрагмент клипа «Disturbed — Bad Man» (2022) (источник: https://youtu.be/fpUpVznI4Yc?si=YYuB04JbtzGfEXft)

В клипе Disturbed — «Bad Man» много намеренных глитч-переходов: лица дергаются, растягиваются, «ломаются» по вертикальным линиям, как будто видео — это повреждённый цифровой файл. Появляются вспышки цифрового шума, эффект «рваного» кадра, когда сеть смешивает два разных образа.

Такие сбои иногда помогают подчеркнуть настроение трека, усилить тему нестабильности или трансформации. Именно поэтому глитч в AI-видео — это не всегда просто баг, но и важный элемент новой эстетики нейросетей.

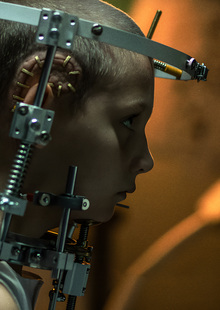

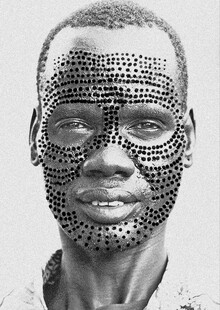

Идентичность, лицо и трансформация: дипфейки в музыкальных видео

Одно из самых заметных направлений в нейросетевых музыкальных видео — работа с лицом и пластикой, которая позволяют работать с идентичностью. Алгоритмы легко меняют мимику, структуру черт, возраст, расу и даже «маски» персонажа, превращая лицо в подвижную «фигуру», а не фиксированное изображение. В отличие от классического клипа, где лицо артиста — стабильный элемент кадра, в нейросетевых видео оно становится материалом для трансформаций: растягивается, дробится, перетекает между состояниями и стилистиками. Эти изменения не просто эффект — они создают новые способы говорить о личности, восприятии и многослойности современного образа артиста.

Кадры из клипа «Disturbed — Bad Man» (2022) (источник: https://youtu.be/fpUpVznI4Yc?si=YYuB04JbtzGfEXft)

В клипе Disturbed — «Bad Man» нейросеть используется для создания агрессивного образа: лица политиков, военных и абстрактных злодеев сливаются друг с другом, превращаясь в единый «архетип плохого человека». Алгоритм меняет выражение глаз, жёсткость линий и структуру кожи так, что визуальный образ начинает выглядеть как коллективное, обезличенное зло.

Кадры из клипа «Disturbed — Bad Man» (2022) (источник: https://youtu.be/fpUpVznI4Yc?si=YYuB04JbtzGfEXft)

В клипе показывается, как AI может разрушить индивидуальность и собрать новое лицо — символическое, пугающее и обобщённое. Идентичность становится не человеческой, а медиатизированной конструкцией (как в примере выше), где образ простого страдающего человека максимально гиперболизирован частой сменой кадров и лиц.

Сниппеты к новому треку артиста Хаски в Instagram* Meta* признана экстремистской организацией в России (2025) (источник: https://www.instagram.com/papinomoloko?igsh=MXhyaG1ndzM1b2RzYg==)

В AI-сниппетах Хаски нейросеть перестраивает его лицо как набор пластических метафор. Черты растягиваются, дробятся, переключаются между масками, будто артист существует одновременно в нескольких состояниях. Алгоритм работает с образом Хаски как с гибким материалом — он стирает привычную единичную жесткость артиста и превращает его в цифровую фигуру, которую можно менять, перегибать и собирать заново в любые самые невозможные состояния.

Трансформации лица из клипа «Kendrick Lamar — The Heart Part 5» (2022) (источник: https://youtu.be/uAPUkgeiFVY?si=hkf13t4SxUgbUEr4)

В клипе Kendrick Lamar — «The Heart Part 5» работа с лицом доведена до максимума. Нейросеть «надевает» на Кендрика лица Канье Уэста, Уилла Смита и других публичных фигур. Но ключевое — не эффект. Важно то, что лицо становится текстом, способом рассказать о коллективном. Каждая трансформация сопровождается изменением интонации и смысла текста.

То есть работа со сменой лиц и идентичностью человека в нейросетях может служить либо как обобщающая и обезличивающая сила, собирающая единый образ из нескольких людей, либо наоборот расширять границы одного человека, позволяя ему примерять самые разные маски.

Заключение

Данное исследование показало, что нейросетевые музыкальные видео действительно сформировали новую форму медиа-арта, где алгоритм выступает не как технический помощник, а как соавтор визуального решения. Примеры вроде «Cadence» и «Lost» демонстрируют: нейросеть способна создавать собственную художественную логику — от абстрактных генеративных фонов и видеорядов до переосмысленных в мультипликационном стиле архивных образов. Она работает иначе, чем человек, поэтому в кадре появляются текучие формы, деформации лиц и тел, глитчи и нестандартные переходы, которые становятся частью рассматриваемого визуального языка.

Набор устойчивых паттернов — абстракции, цифровые сбои, трансформации лица, сетевые сниппеты — подтверждает, что у AI-клипов уже есть собственная эстетика, родственная медиа-арту. Но при этом важно понимать: нейросеть всё ещё далека от идеального инструмента. Она ошибается, создаёт артефакты, иногда «ломает» изображение и требует человеческого контроля. Однако именно в сочетании алгоритма и человеческой интуиции возникает сильный результат — когда художник задаёт направление, а нейросеть предлагает неожиданные решения.

Таким образом, нейросетевые музыкальные видео становятся площадкой для нового типа творчества, где визуальный образ рождается из «общения» человека и машины. И хотя технология ещё развивается, уже сейчас очевидно, что этот гибридный формат постепенно превращается в самостоятельное направление современного медиа-арта, которое нашло хорошее развитие в рамках музыкальной индустрии 2022–2025 годов.

Егор Летов — Убегает весь мир. Видеотрибьют от Яндекс.Музыки [видео]. — Электронный ресурс. — Режим доступа: https://youtu.be/_TTwA5dYsgE?si=HXfsTW0hp-EQEnm3. — Просмотрено: 16.11.2025.

Исследование «Использование нейронных сетей в музыкальной индустрии» // КиберЛенинка. — Режим доступа: https://cyberleninka.ru/article/n/ispolzovanie-neyronnyh-setey-v-muzykalnoy-industrii. — Просмотрено: 17.11.2025.

Пауэр, К. Ю., Кузнецов, А. А. Нейросети как инструмент генерации художественных образов на примере клипа «Убегает весь мир» на песню Егора Летова «Без меня» // Языкознание и литературоведение. — 2023. — С. 164. — Просмотрено: 15.11.2025.

Зайцев, А. Я. Нейросети в современном анимационном искусстве: эстетические инновации и новые горизонты // Культура и искусство. — 2024. — № 12. — С. 73. — Просмотрено: 16.11.2025.

Domo AI [Электронный ресурс]. — Режим доступа: https://www.domoai.app. — Просмотрено: 13.11.2025.

Disturbed — Bad Man [Official Music Video] [видео]. — Электронный ресурс. — Режим доступа: https://youtu.be/fpUpVznI4Yc?si=YYuB04JbtzGfEXft. — Просмотрено: 15.11.2025.

Instagram. Профиль PapinoMoloko [Электронный ресурс]. — Режим доступа: https://www.instagram.com/papinomoloko?igsh=MXhyaG1ndzM1b2RzYg==. — Просмотрено: 15.11.2025.

James Adrian Brown — Cadence [видео]. — Электронный ресурс. — Режим доступа: https://youtu.be/7OG2c03Gn1Y?si=ZV_RW1SLVygm9Sjw. — Просмотрено: 13.11.2025.

Kaibarai [Электронный ресурс]. — Режим доступа: https://kaibarai.com. — Просмотрено: 13.11.2025.

Kendrick Lamar — The Heart Part 5 [видео]. — Электронный ресурс. — Режим доступа: https://youtu.be/uAPUkgeiFVY?si=hkf13t4SxUgbUEr4. — Просмотрено: 13.11.2025.

Linkin Park — Lost [Official Music Video] [видео]. — Электронный ресурс. — Режим доступа: https://youtu.be/7NK_JOkuSVY?si=HcU4i8Go6CJWGizI. — Просмотрено: 13.11.2025.

Limebridge — Reason (Official Music Video) [видео]. — Электронный ресурс. — Режим доступа: https://youtu.be/qvhHhV1Atyk?si=wMzaT_Bri7L9bbGP. — Просмотрено: 16.11.2025.

Limebridge. We let AI make our music video, it turned out kinda beautiful… but is it still real art? Reddit, r/AIVideos, 19 мая 2025. — Режим доступа: https://www.reddit.com/r/aivideos/comments/1kq4xhj. — Просмотрено: 15.11.2025.

MidJourney [Электронный ресурс]. — Режим доступа: https://www.midjourney.com/home. — Просмотрено: 13.11.2025.

PNAU, Bebe Rexha, Ozuna — Stars (Official Video) [видео]. — Электронный ресурс. — Режим доступа: https://youtu.be/Aox5s2s_SEI?si=mOt9vPFKxR79cejJ. — Просмотрено: 16.11.2025.

Pika.art [Электронный ресурс]. — Режим доступа: https://pika.art/login. — Просмотрено: 13.11.2025.

Periphery — Atropos (Official Music Video) [видео]. — Электронный ресурс. — Режим доступа: https://youtu.be/Ppg8kpG-lio?si=1UwBcKsAmlil5Axm. — Просмотрено: 15.11.2025.

Runway ML [Электронный ресурс]. — Режим доступа: https://runwayml.com. — Просмотрено: 13.11.2025.

Suno [Электронный ресурс]. — Режим доступа: https://suno.com/home. — Просмотрено: 13.11.2025.

Washed Out — The Hardest Part (Official Video) [видео]. — Электронный ресурс. — Режим доступа: https://youtu.be/-Nb-M1GAOX8?si=0hEHA_IMmKw-KBKS. — Просмотрено: 13.11.2025.

Within Temptation — Bleed Out (Official Music Video) [видео]. — Электронный ресурс. — Режим доступа: https://youtu.be/dBilK-h3lRQ?si=eyU_NPcRZ2qxnk8N. — Просмотрено: 16.11.2025.